То, с чем не справились в Facebook, в Китае взяли под контроль: прямые трансляции премодерируют сотни сотрудников, а помогают им в этом искусственный интеллект и системы слежения.

Нападки на Facebook, Alphabet Inc. и YouTube со стороны чиновников и общественных деятелей прошли на фоне недавнего теракта 15 марта в Новой Зеландии, в результате чего погибли 50 человек. Компании не смогли быстро удалить видео, транслируемое предполагаемым боевиком в прямом эфире.

В первые часы после теракта 17-минутное полное видео или его фрагменты широко разошлись по социальным сетям, его, несмотря на призывы полиции не делать этого, использовали СМИ, в том числе австралийские. Корпорацию Facebook подвергли критике за то, что она, вопреки своим собственным правилам, не заблокировала трансляцию и недостаточно активно препятствовала распространению видео.

Марк Цукерберг не признает провала со своей стороны и утверждает, что видео успели посмотреть только 4 тыс. раз, прежде чем оно было заблокировано на платформе, а потому не считает необходимым вводить задержку при прямой трансляции. В интервью телеканалу ABC на вопрос о том, позволила бы такая задержка сократить число просмотров прямой трансляции теракта в Крайстчёрче, Цукерберг ответил утвердительно. «Да, так могло быть в данном случае», — заявил он.

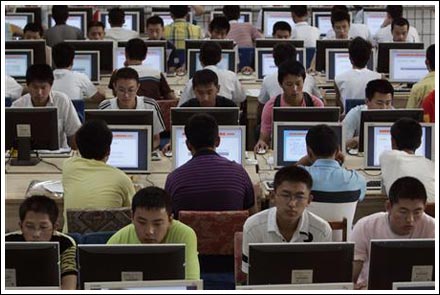

В Поднебесной для контроля над трансляциями в интернете компании нанимают армии цензоров. По состоянию на конец прошлого года почти 400 млн человек стране проводили трансляции. Большая часть этого контента безобидна: показывать родным и друзьям дома достопримечательности Парижа или демонстрировать, что приготовлено на обед или ужин.

Есть также профессиональные стримеры, которые зарабатывают этим на жизнь, так же как это происходит в YouTube. И это все, не считая коротких видео, мессенджеров, онлайн-форумов и других мест и форматов, где пользователи генерируют терабайты видеоконтента. Все это мониторить вручную, естественно, невозможно.

Стартап Inke как раз занимается мониторингом видеоконтента. В интервью газете South China Morning Post основатели компании рассказали, что модераторам помогают алгоритмы искусственного интеллекта и программное обеспечение для распознавания лиц.

Искусственный интеллект используется для выполнения основной работы по маркировке, оценке и сортировке контента по различным категориям риска. Эта система классификации позволяет компании выделять ресурсы в порядке возрастания риска. Один рецензент может отслеживать больше контента с низким уровнем риска, например кулинарные шоу, а контент с высоким риском помечается для более тщательного изучения.

Модераторы-люди необходимы для оценки того, в чем машины разбираются не очень — в контексте. Для примера журналисты приводят бикини. Женский купальник для компьютера не значит ничего. Но для человека бикини в разных контекстах может означать совершенно разные вещи. Например, демонстрация бикини в бассейне с бегающими детьми? Можно опубликовать. Откровенный купальник в интерьере спальни с романтичной фоновой музыкой? Скорее всего, это видео заблокируют.

Тем не менее наибольшей цензуре подвергается на платформе Inke курение, так как власти считают, что это способствует нездоровому образу жизни. Показывать чрезмерные количество татуировок — тоже нет.

Китай активно мониторит и подвергает цензуре контент, где критикуют правящую Коммунистическую партию или упоминаются чувствительные темы типа Далай-ламы, события на площади Тяньаньмэнь, преследования Фалуньгун. Пекин оправдывает «Великий китайский файрвол», поскольку система сетевой цензуры трактуется как право на «киберсуверенитет», где каждая страна имеет право контролировать свое внутреннее интернет-пространство.

Команда модераторов Inle самая крупная: на ее долю приходится около 60% всех сотрудников. Модераторы работают с подробными правилами, разъясняющими, что разрешено и что должно быть удалено. На основе руководства, опубликованного Китайской ассоциацией исполнительских искусств, учебное пособие обновляется еженедельно, чтобы в нем учитывались все актуальные случаи.

Контент с наибольшим риском включает политически чувствительные высказывания, сексуальные акты, насилие, терроризм и суицид. В зависимости от серьезности нарушения модераторы контента могут выдавать предупреждение, блокировать или помещать в черный список учетную запись.

Модераторам помогает тот факт, что прямые трансляции в действительности не являются «живыми», а имеют встроенную задержку в 10–15 секунд. Именно в этом узком окне модератор должен решить, разрешить ли трансляцию сомнительного контента.

У Inke есть еще один эффективный инструмент подавления нежелательного контента: когда жители начали собираться в знак протеста против плана местного правительства по строительству мусоросжигательного завода, Inke использовала программное обеспечение для определения местоположения устройств, чтобы заблокировать все трансляции в радиусе 10 км.

Несмотря на высокий спрос на контент-модераторов, сама работа довольно монотонная и не очень хорошо оплачивается. В основном люди должны часами смотреть на плохое пение, посредственные шутки и скучные монологи. Из 1200 модераторов Inke около 200 являются штатными сотрудниками, а остальные работают по контракту. Начальная зарплата составляет 3 тыс. юаней в месяц, или $3 в час, по сравнению с минимальной заработной платой в Нью-Йорке в $15 в час. Многие новые сотрудники увольняются, прежде чем завершить обязательный месячный учебный курс. Другие уходят в течение шести месяцев.

lj-spoiler title=»источники»>

https://www.vestifinance.ru/articles/117536